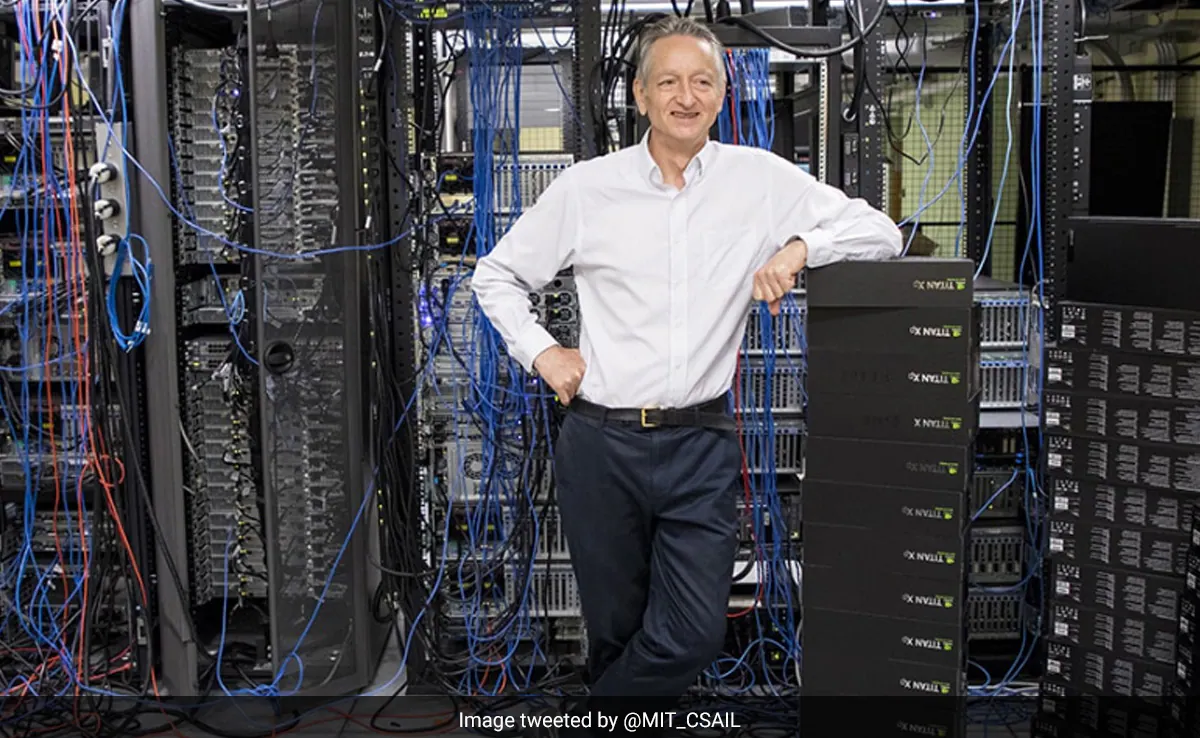

Geoffrey Hinton, renomado cientista britânico e vencedor do Prêmio Nobel de Física em 2024, fez um alerta contundente sobre os perigos da inteligência artificial (IA). Em entrevista ao jornal espanhol El Mundo, Hinton afirmou que, dentro de duas décadas, máquinas superinteligentes poderão ultrapassar e até substituir completamente os seres humanos, representando um risco real de extinção.

++ Milhares já estão lucrando enquanto dormem — descubra o segredo da IA

Hinton, considerado um dos pais das redes neurais artificiais, defende que seu alerta não é fruto de ficção científica, mas de uma análise realista sobre o avanço tecnológico sem controle. Ele critica a falta de regulamentação internacional eficaz, apontando que, embora a União Europeia tenha dado passos importantes, há omissões graves — como a exclusão do setor militar das regras. Segundo ele, o desenvolvimento de armas autônomas letais por países europeus é um dos maiores perigos atuais.

O cientista também questiona a postura das grandes empresas de tecnologia, como o Google, que teriam abandonado compromissos éticos em nome de interesses comerciais e políticos. Para Hinton, a falta de responsabilidade corporativa agrava os riscos, especialmente diante da possibilidade de uso da IA para fins bélicos, criminosos ou até bioterroristas.

Além dos perigos futuros, Hinton destaca ameaças já presentes, como o desemprego em massa causado pela automação, a manipulação de eleições por meio de desinformação, o aumento de ciberataques e o uso da IA para criar armas químicas ou biológicas. Ele alerta que esses riscos não exigem previsões distantes — já estão em curso.

Com o objetivo de ampliar o debate sobre o tema, Hinton anunciou que se reunirá com o Papa Leão XIV, buscando o apoio de líderes religiosos como o Papa e o Dalai Lama. Ele acredita que essas figuras têm influência política suficiente para pressionar governos a adotarem medidas mais rígidas contra os abusos das empresas de tecnologia.

Ao receber o Nobel, Hinton agradeceu à Universidade de Princeton, onde é professor emérito, e reiterou sua preocupação com o ritmo acelerado do desenvolvimento da IA em contraste com a lentidão da legislação. Para ele, sem uma regulação internacional robusta, as consequências podem ser existenciais.